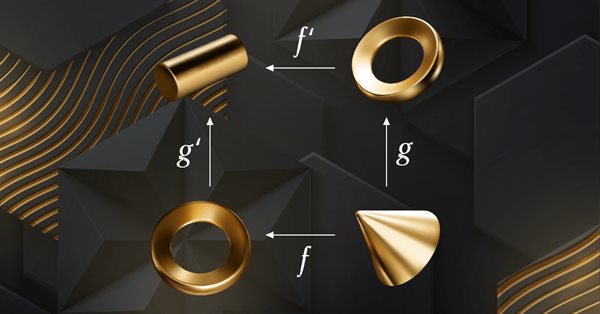

MQL5 中的范畴论 (第 6 部分):单态回拉和满态外推

MetaTrader 中的多机器人:从单图表中启动多个机器人

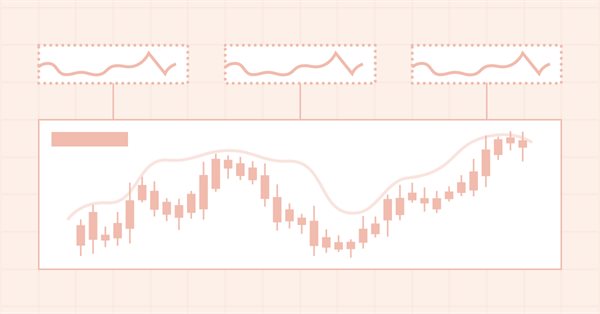

如何利用 MQL5 检测蜡烛形态

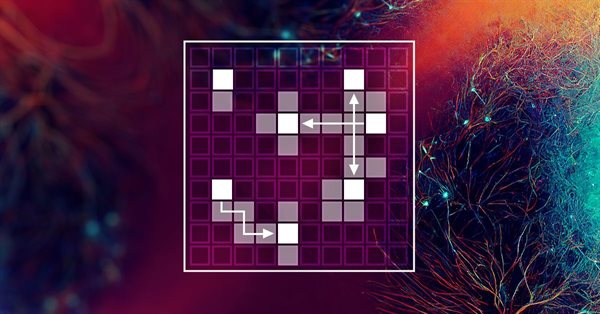

神经网络实验(第 4 部分):模板

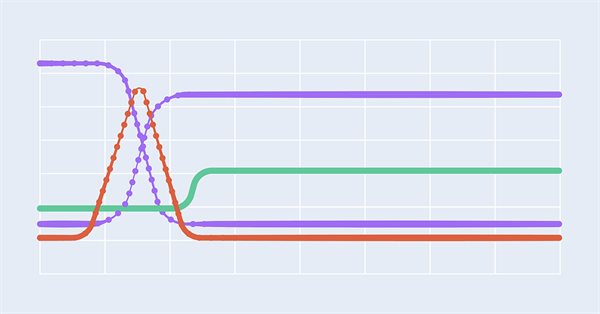

神经网络变得轻松(第三十六部分):关系强化学习

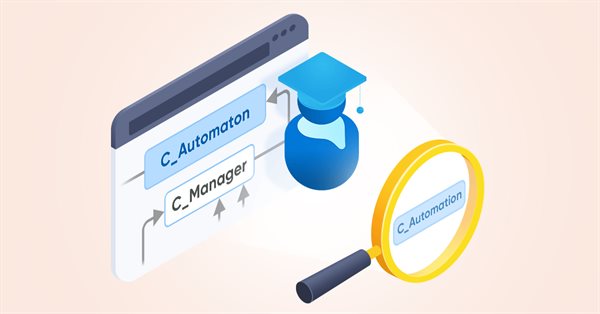

构建自动运行的 EA(第 14 部分):自动化(VI)

多层感知器和反向传播算法(第 3 部分):与策略测试器集成 - 概述(I)

构建自动运行的 EA(第 13 部分):自动化(V)

DoEasy 函数库中的其他类(第七十一部分):图表对象集合事件

DoEasy 库中的其他类(第六十八部分):图表窗口对象类和图表窗口中的指标对象类

DoEasy 库中的其他类(第六十七部分):图表对象类

DoEasy 函数库中的价格(第六十三部分):市场深度及其抽象请求类

DoEasy 函数库中的时间序列(第六十一部分):品种即时报价序列集合

DoEasy 函数库中的时间序列(第六十部分):品种即时报价数据的序列列表

DoEasy 函数库中的时间序列(第五十七部分):指标缓冲区数据对象

DoEasy 函数库中的时间序列(第五十六部分):自定义指标对象,从集合中的指标对象获取数据

DoEasy 函数库中的时间序列(第五十四部分):抽象基准指标类的衍生

在 MetaTrader 5 中测试和优化二元期权策略

连续前行优化 (第八部分): 程序改进和修复

构建自动运行的 EA(第 12 部分):自动化(IV)

构建自动运行的 EA(第 11 部分):自动化(III)

神经网络实验(第 3 部分):实际应用

构建自动运行的 EA(第 09 部分):自动化(II)

构建自动运行的 EA(第 09 部分):自动化(I)

神经网络变得轻松(第三十五部分):内在好奇心模块

构建自动运行的 EA(第 08 部分):OnTradeTransaction

神经网络变得轻松(第三十四部分):全部参数化的分位数函数

非线性指标

构建自动运行的 EA(第 07 部分):账户类型(II)

神经网络变得轻松(第三十三部分):分布式 Q-学习中的分位数回归

构建自动运行的 EA(第 06 部分):账户类型(I)

构建自动运行的 EA(第 05 部分):手工触发器(II)

构建自动运行的 EA(第 04 部分):手工触发器(I)

构建自动运行的 EA(第 03 部分):新函数

构建自动运行的 EA(第 02 部分):开始编码

构建自动运行的 EA(第 01 部分):概念和结构

神经网络变得轻松(第三十二部分):分布式 Q-学习

帧分析器(Frames Analyzer)工具带来的时间片交易魔法