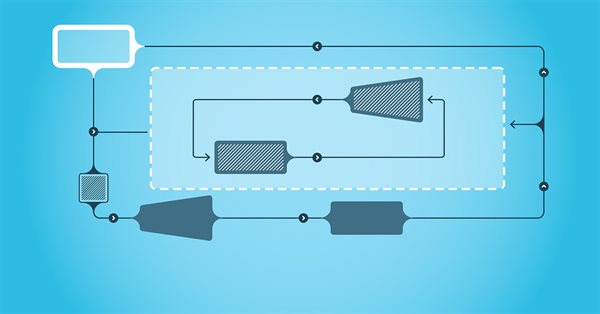

如何利用 MQL5 创建简单的多币种智能交易系统(第 1 部分):基于 ADX 指标的信号,并结合抛物线 SAR

神经网络变得轻松(第五十三部分):奖励分解

神经网络变得轻松(第五十二部分):研究乐观情绪和分布校正

神经网络变得轻松(第五十一部分):行为-指引的扮演者-评论者(BAC)

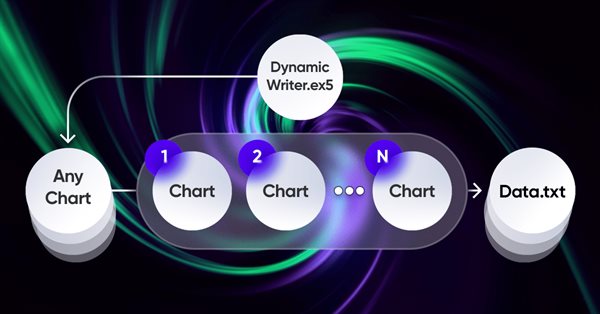

创建多交易品种、多周期指标

为莫斯科交易所开发一个交易机器人从哪里开始呢?

神经网络变得轻松(第五十部分):软性扮演者-评价者(模型优化)

MQL5中的替代风险回报标准

为EA交易提供指标的现成模板(第3部分):趋势指标

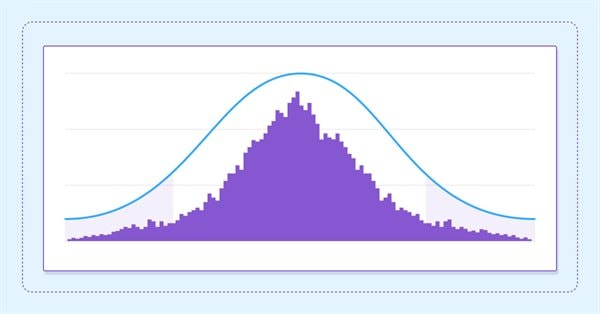

用置信区间估计未来效能

为EA交易提供指标的现成模板(第2部分):交易量和比尔威廉姆斯指标

神经网络变得轻松(第四十九部分):软性扮演者-评价者

模式搜索的暴力方法(第六部分):循环优化

了解使用MQL5下单

神经网络变得轻松(第四十八部分):降低 Q-函数高估的方法

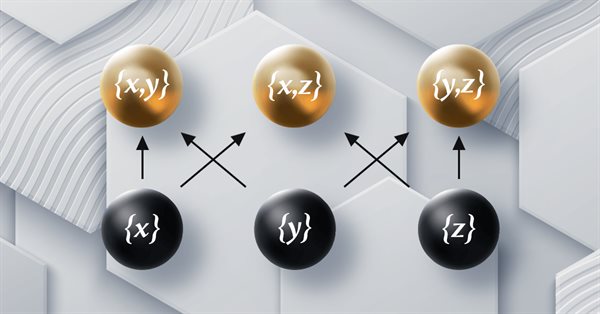

MQL5 中的范畴论 (第 12 部分):秩序(Orders)

MQL5 中的范畴论 (第 11 部分):图论

神经网络变得轻松(第四十七部分):连续动作空间

重新审视一种旧时的趋势交易策略:两个随机振荡指标,一个移动平均指标和斐波那契线

MQL5中的ALGLIB数值分析库

简单均值回归交易策略

Heiken-Ashi指标与移动平均指标组合能够提供好的信号吗?

神经网络变得轻松(第四十六部分):条件导向目标强化学习(GCRL)

MQL5 中的范畴论 (第 10 部分):幺半群组

为智能系统制定品质因数

神经网络变得轻松(第四十五部分):训练状态探索技能

神经网络变得轻松(第四十四部分):动态学习技能

神经网络变得轻松(第四十三部分):无需奖励函数精通技能

神经网络变得轻松(第四十二部分):模型拖延症、原因和解决方案

神经网络变得轻松(第四十部分):在大数据上运用 Go-Explore

神经网络变得轻松(第三十九部分):Go-Explore,一种不同的探索方式

在类中包装 ONNX 模型

您应该知道的 MQL5 向导技术(第 06 部分):傅里叶(Fourier)变换

神经网络变得轻松(第三十八部分):凭借分歧进行自我监督探索

在莫斯科交易所(MOEX)里使用破位挂单的自动兑换网格交易

神经网络变得轻松(第三十七部分):分散关注度

另一个 MQL5 OOP 类

MQL5 中的范畴论 (第 7 部分):多域、相对域和索引域