开发多币种 EA 交易(第 2 部分):过渡到交易策略的虚拟仓位

神经网络变得简单(第 70 部分):封闭式政策改进运算器(CFPI)

交易中的追踪止损

神经网络变得简单(第 69 部分):基于密度的行为政策支持约束(SPOT)

MQL5 简介(第 3 部分):掌握 MQL5 的核心元素

神经网络变得简单(第 68 部分):离线优先引导政策优化

开发多币种 EA 交易(第 1 部分):多种交易策略的协作

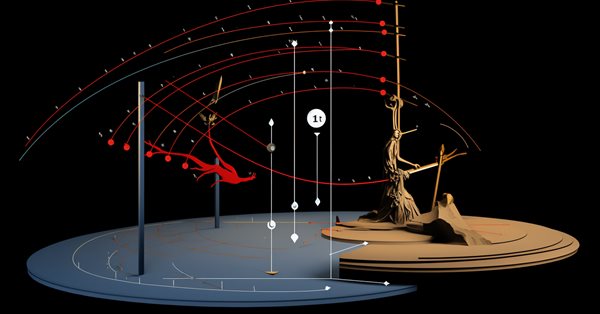

构建和测试 Aroon 交易系统

使用 Python 和 MetaTrader5 python 软件包及 ONNX 模型文件进行深度学习预测和排序

用于时间序列挖掘的数据标签(第 6 部分):使用 ONNX 在 EA 中应用和测试

用于时间序列挖掘的数据标签(第 5 部分):使用 Socket 在 EA 中进行应用和测试

MQL5 简介(第 2 部分):浏览预定义变量、通用函数和控制流语句

改编版 MQL5 网格对冲 EA(第 1 部分):制作一个简单的对冲 EA

理解编程范式(第 1 部分):开发价格行为智能系统的过程化方式

在 MQL5 中创建做市商算法

MQL5 中的定量分析:实现有前途的算法

软件开发和 MQL5 中的设计范式(第 4 部分):行为范式 2

神经网络变得简单(第 66 部分):离线学习中的探索问题

软件开发和 MQL5 中的设计范式(第 3 部分):行为范式 1

MQL5 简介(第 1 部分):算法交易新手指南

Python、ONNX 和 MetaTrader 5:利用 RobustScaler 和 PolynomialFeatures 数据预处理创建 RandomForest 模型

利用 Python 和 MQL5 构建您的第一个玻璃盒模型

软件开发和 MQL5 中的设计模式(第 2 部分):结构模式

MQL5 中的组合对称交叉验证

您应当知道的 MQL5 向导技术(第 09 部分):K-Means 聚类与分形波配对

如何利用 MQL5 创建简单的多币种智能交易系统(第 5 部分):凯尔特纳(Keltner)通道上的布林带 — 指标信号

神经网络变得简单(第 67 部分):按照过去的经验解决新任务

CatBoost 模型中的交叉验证和因果推理基础及导出为 ONNX 格式

交易者容易使用的止损和止盈

神经网络变得简单(第 65 部分):距离加权监督学习(DWSL)

如何利用 MQL5 创建简单的多币种智能交易系统(第 4 部分):三角移动平均线 — 指标信号

神经网络变得简单(第 64 部分):保守加权行为克隆(CWBC)方法

神经网络变得简单(第 63 部分):决策转换器无监督预训练(PDT)

如何利用 MQL5 创建简单的多币种智能交易系统(第 3 部分):添加交易品种、前缀和/或后缀、以及交易时段

神经网络变得简单(第 62 部分):在层次化模型中运用决策转换器

神经网络变得简单(第 61 部分):离线强化学习中的乐观情绪问题

您应当知道的 MQL5 向导技术(第 07 部分):树状图

神经网络变得简单(第 60 部分):在线决策转换器(ODT)