用于时间序列挖掘的数据标签(第 6 部分):使用 ONNX 在 EA 中应用和测试

种群优化算法:进化策略,(μ,λ)-ES 和 (μ+λ)-ES

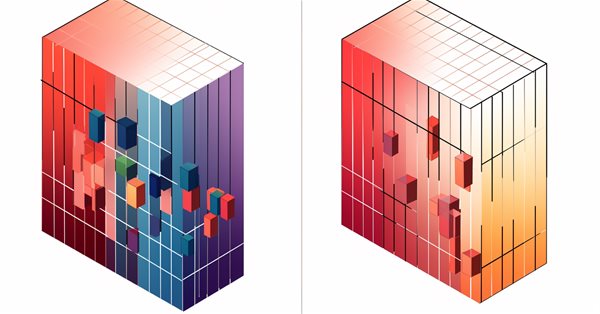

数据科学和机器学习(第 17 部分):摇钱树?外汇交易中随机森林的艺术与科学

用于时间序列挖掘的数据标签(第 5 部分):使用 Socket 在 EA 中进行应用和测试

数据科学和机器学习(第 16 部分):全新面貌的决策树

MQL5 简介(第 2 部分):浏览预定义变量、通用函数和控制流语句

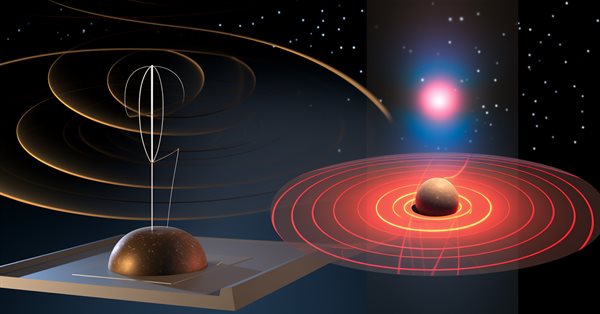

种群优化算法:模拟各向同性退火(SIA)算法。第 II 部分

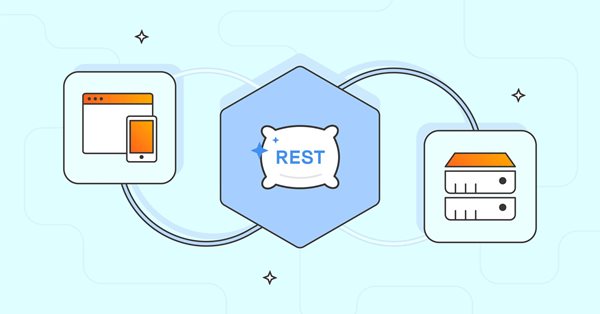

开发具有 RestAPI 集成的 MQL5 强化学习代理(第 3 部分):在 MQL5 中创建自动移动和测试脚本

种群优化算法:模拟退火(SA)。第 1 部分

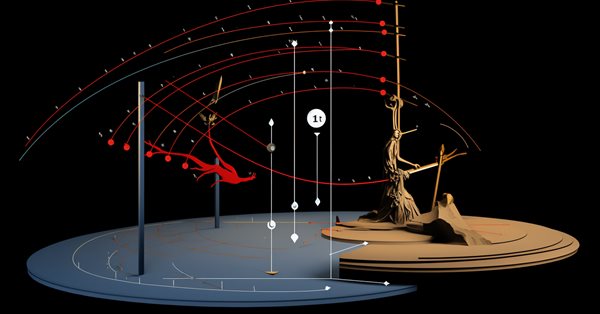

神经网络变得简单(第 66 部分):离线学习中的探索问题

MQL5 简介(第 1 部分):算法交易新手指南

Python、ONNX 和 MetaTrader 5:利用 RobustScaler 和 PolynomialFeatures 数据预处理创建 RandomForest 模型

利用 Python 和 MQL5 构建您的第一个玻璃盒模型

群体优化算法:差分进化(DE)

精通模型解释:从您的机器学习模型中获取深入见解

群体优化算法:螺旋动态优化 (SDO) 算法

您应当知道的 MQL5 向导技术(第 09 部分):K-Means 聚类与分形波配对

群体优化算法:智能水滴(IWD)算法

神经网络变得简单(第 67 部分):按照过去的经验解决新任务

您应当知道的 MQL5 向导技术(第 08 部分):感知器

种群优化算法:Nelder-Mead(NM),或单纯形搜索方法

神经网络变得简单(第 65 部分):距离加权监督学习(DWSL)

机器学习中的量化(第 2 部分):数据预处理、表格选择、训练 CatBoost 模型

神经网络变得简单(第 64 部分):保守加权行为克隆(CWBC)方法

开发具有 RestAPI 集成的 MQL5 强化学习代理(第 1 部分):如何在 MQL5 中使用 RestAPI

神经网络变得简单(第 63 部分):决策转换器无监督预训练(PDT)

群体优化算法:带电系统搜索(CSS)算法

神经网络变得简单(第 62 部分):在层次化模型中运用决策转换器

Scikit-Learn 库中的分类模型及其导出到 ONNX

神经网络变得简单(第 61 部分):离线强化学习中的乐观情绪问题

您应当知道的 MQL5 向导技术(第 07 部分):树状图

神经网络实验(第 7 部分):传递指标

群体优化算法:随机扩散搜索(SDS)

神经网络变得简单(第 60 部分):在线决策转换器(ODT)

群体优化算法:思维进化计算(MEC)算法

神经网络变得简单(第 59 部分):控制二分法(DoC)

群体优化算法:混合蛙跳算法(SFL)

神经网络变得简单(第 58 部分):决策转换器(DT)