神经网络变得轻松(第四十部分):在大数据上运用 Go-Explore

神经网络变得轻松(第三十九部分):Go-Explore,一种不同的探索方式

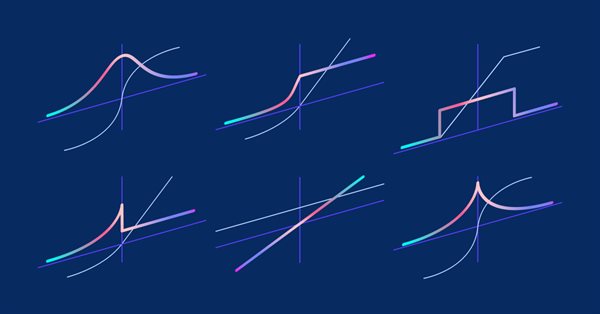

MQL5 中的矩阵和向量:激活函数

在类中包装 ONNX 模型

神经网络变得轻松(第三十八部分):凭借分歧进行自我监督探索

神经网络变得轻松(第三十七部分):分散关注度

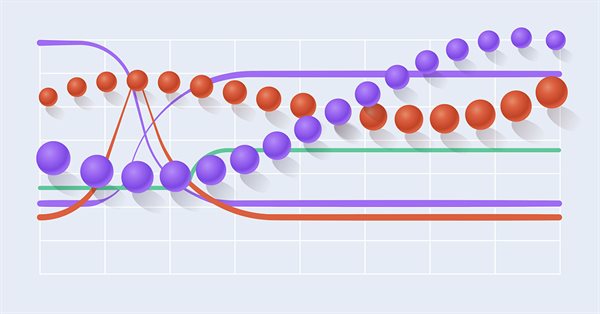

神经网络实验(第 6 部分):自给自足的价格预测工具 — 感知器

神经网络实验(第 5 部分):常规化传输到神经网络的输入参数

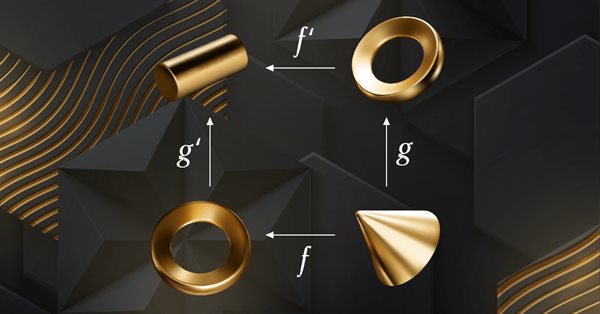

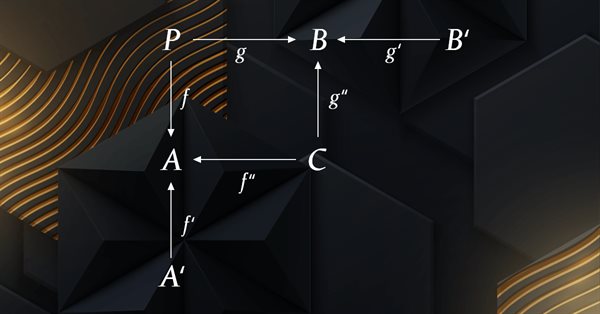

MQL5 中的范畴论 (第 6 部分):单态回拉和满态外推

如何在 MQL5 中集成 ONNX 模型的示例

MQL5 中的范畴论 (第 5 部分):均衡器

如何在 MQL5 中使用 ONNX 模型

种群优化算法:类电磁算法(EM - ElectroMagnetism)

MQL5 中的范畴论 (第 4 部分):跨度、实验、及合成

数据科学和机器学习(第 14 部分):运用 Kohonen 映射在市场中寻找出路

种群优化算法:树苗播种和成长(SSG)算法

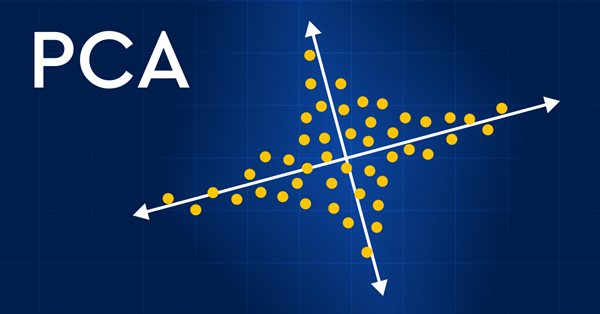

数据科学和机器学习(第 13 部分):配合主成分分析(PCA)改善您的金融市场分析

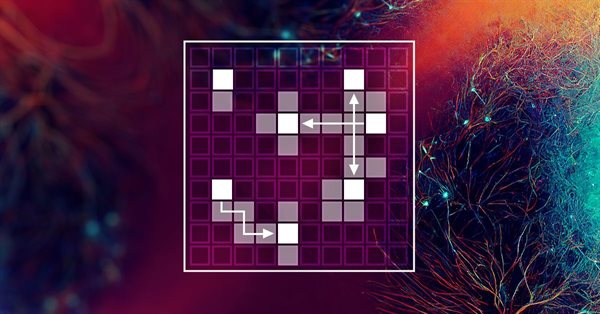

数据科学和机器学习(第 12 部分):自训练神经网络能否帮助您跑赢股市?

神经网络实验(第 4 部分):模板

神经网络变得轻松(第三十六部分):关系强化学习

种群优化算法:猴子算法(MA)

将 ML 模型与策略测试器集成(第 3 部分):CSV(II)文件管理

MQL5 中的范畴论 (第 2 部分)

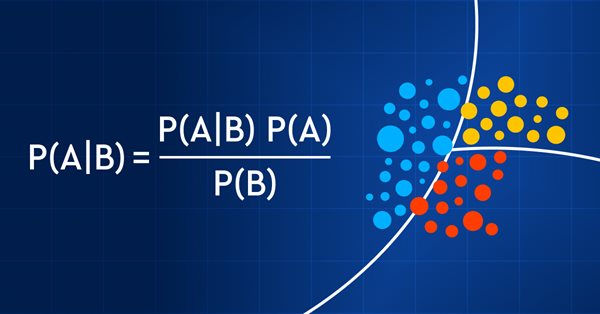

数据科学与机器学习(第 11 部分):朴素贝叶斯(Bayes),交易中的概率论

种群优化算法:和弦搜索(HS)

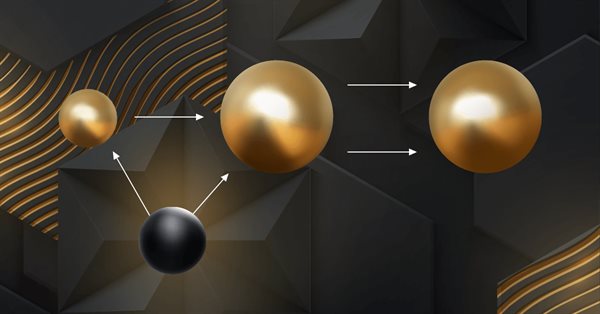

种群优化算法:引力搜索算法(GSA)

衡量指标信息

MQL5 中的范畴论 (第 2 部分)

种群优化算法:细菌觅食优化(BFO)

种群优化算法:入侵杂草优化(IWO)

神经网络实验(第 3 部分):实际应用

种群优化算法:蝙蝠算法(BA)

种群优化算法:萤火虫算法(FA)

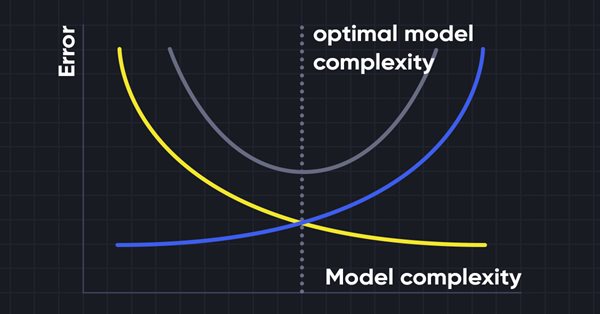

数据科学与机器学习(第 10 部分):岭回归

矩阵实用工具,扩展矩阵和向量的标准库功能

MQL5 中的范畴论 (第 1 部分)

种群优化算法:鱼群搜索(FSS)

神经网络变得轻松(第三十五部分):内在好奇心模块