神经网络变得轻松(第三十四部分):全部参数化的分位数函数

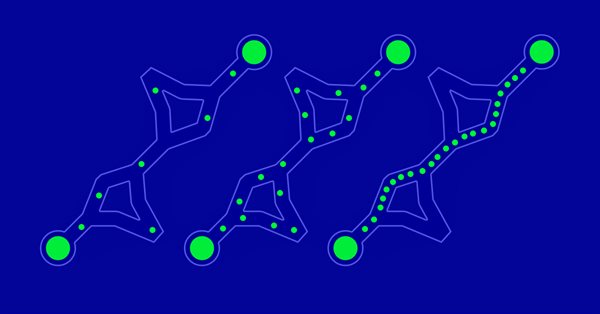

种群优化算法:人工蜂群(ABC)

神经网络变得轻松(第三十三部分):分布式 Q-学习中的分位数回归

神经网络变得轻松(第三十二部分):分布式 Q-学习

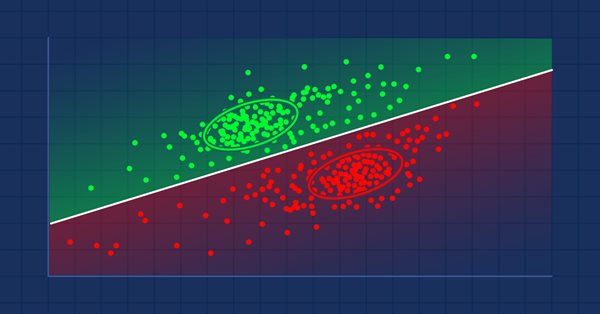

您应该知道的 MQL5 向导技术(第 04 部分):线性判别分析

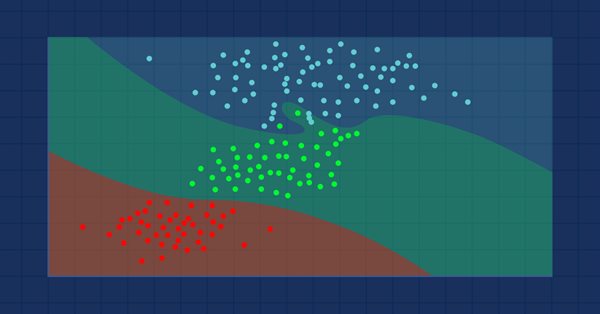

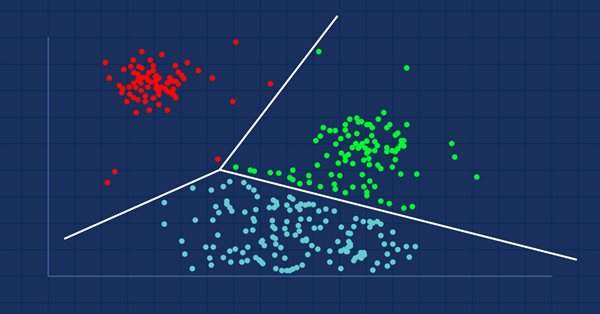

数据科学与机器学习(第 09 部分):K-最近邻算法(KNN)

种群优化算法:蚁群优化(ACO)

数据科学与机器学习(第 09 部分):以 MQL5 平铺直叙 K-均值聚类

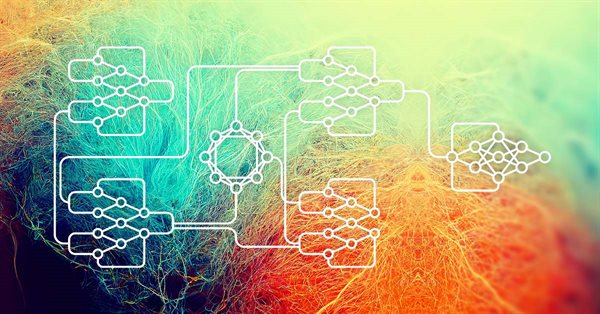

神经网络变得轻松(第三十一部分):进化算法

群体优化算法:粒子群(PSO)

数据科学与机器学习(第 07 部分):多项式回归

您应该知道的 MQL5 向导技术(第 03 部分):香农(Shannon)熵

神经网络变得轻松(第三十部分):遗传算法

神经网络变得轻松(第二十九部分):优势扮演者-评价者算法

神经网络变得轻松(第二十八部分):政策梯度算法

神经网络变得轻松(第二十七部分):深度 Q-学习(DQN)

神经网络变得轻松(第二十六部分):强化学习

数据科学与机器学习 — 神经网络(第 02 部分):前馈神经网络架构设计

神经网络变得轻松(第二十五部分):实践迁移学习

神经网络变得轻松(第二十四部分):改进迁移学习工具

神经网络变得轻松(第二十三部分):构建迁移学习工具

神经网络变得轻松(第二十二部分):递归模型的无监督学习

数据科学与机器学习(第 06 部分):梯度下降

神经网络变得轻松(第二十一部分):变分自动编码器(VAE)

神经网络实验(第 2 部分):智能神经网络优化

神经网络变得轻松(第二十部分):自动编码器

神经网络变得轻松(第十九部分):使用 MQL5 的关联规则

神经网络变得轻松(第十八部分):关联规则

数据科学和机器学习(第 05 部分):决策树

机器学习和交易中的元模型:交易订单的原始时序

神经网络实验(第 1 部分):重温几何学

神经网络变得轻松(第十七部分):降低维度

数据科学和机器学习(第 04 部分):预测当前股市崩盘

神经网络变得轻松(第十六部分):聚类运用实践

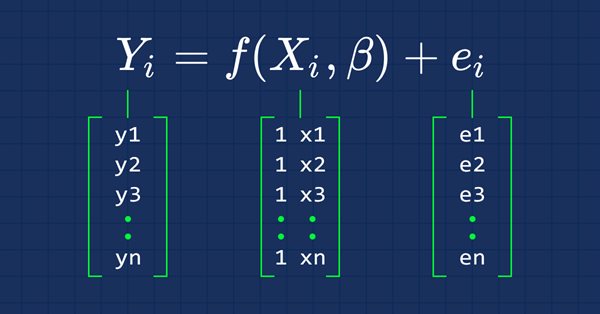

数据科学与机器学习(第 03 部分):矩阵回归

神经网络变得轻松(第十五部分):利用 MQL5 进行数据聚类

神经网络变得轻松(第十四部分):数据聚类

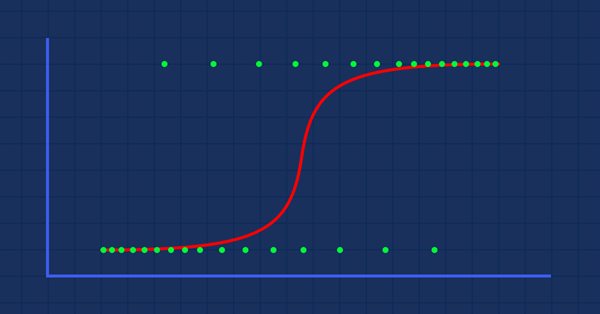

数据科学与机器学习(第 02 部分):逻辑回归